Czym jest plik Robots.txt i jak wpływa na pozycjonowanie strony w Google

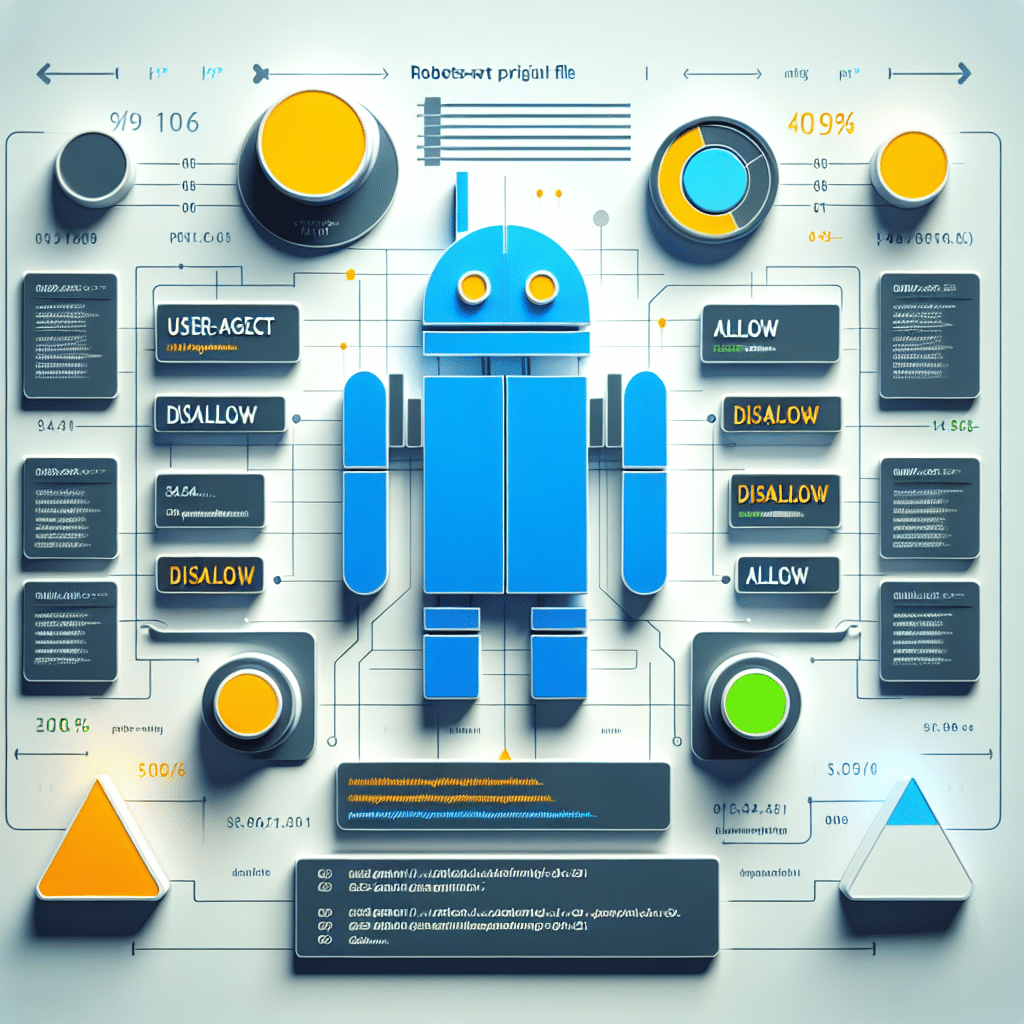

Plik robots.txt to jedno z podstawowych narzędzi w arsenale każdego webmastera, które odpowiada za zarządzanie dostępem robotów wyszukiwarek do poszczególnych sekcji serwisu internetowego. Wykorzystanie tego pliku w odpowiedni sposób ma znaczący wpływ na pozycjonowanie strony w Google, gdyż pozwala wykluczyć z indeksacji te części serwisu, które mogłyby negatywnie wpłynąć na jego widoczność w wynikach wyszukiwania.

Rola i znaczenie pliku robots.txt

Robots.txt działa jak instrukcja dla robotów Google, pokazując, które ścieżki i zasoby na stronie powinny być skanowane, a które pominięte. Dzięki temu możemy zapobiec indeksowaniu tych treści, które są mniej ważne lub duplikowane, a skupić uwagę robotów na kluczowych dla SEO zawartościach. Ważne jest, aby plik był poprawnie sformatowany i dostępny pod standardową ścieżką (domena.pl/robots.txt), gdyż błędy w tym obszarze mogą powodować niezamierzone blokady dla robotów Google.

Optymalizacja pliku robots.txt dla lepszego SEO

W kontekście SEO, precyzyjna konfiguracja pliku robots.txt jest krytyczna. Należy upewnić się, że wszystkie istotne dla pozycjonowania zasoby są dostępne dla robotów wyszukiwarek. Z drugiej strony, blokowanie dostępu do obszarów takich jak panele administracyjne, skrypty, czy duże pliki multimedialne, może przyspieszyć proces indeksacji ważnych treści oraz zachować większą część dostępnego budżetu indeksacyjnego.

Zachowanie równowagi między dostępnością a ochroną

Warto pamiętać, że robots.txt to nie tylko narzędzie SEO, ale również element zabezpieczający. Niewłaściwe użycie może odsłonić wrażliwe sekcje strony, dlatego należy zważyć, co faktycznie powinno być wykluczone z indeksacji, a co jedynie z ograniczonym dostępem dla użytkowników. Silne pozycjonowanie w Google jest efektem nie tylko odpowiedniej optymalizacji treści i backlinków, ale również inteligentnego zarządzania tym, co roboty mogą przeglądać.

Zastosowanie pliku robots.txt jako części strategii SEO wymaga przemyślanych działań i regularnych przeglądów. Powinno się systematycznie sprawdzać efektywność jego ustawień, by upewnić się, że wspierają one cele pozycjonowania, a nie działają na ich niekorzyść. Pamiętaj, że nawet drobne zmiany w robots.txt mogą mieć długofalowy wpływ na widoczność Twojej strony w Google, dlatego zadbanie o jego właściwą konfigurację jest niezbędnym elementem prowadzenia zdrowej i skutecznej strategii SEO.

Jak stworzyć plik Robots.txt krok po kroku

Rozumienie znaczenia pliku Robots.txt

Tworzenie pliku Robots.txt jest istotnym krokiem w optymalizacji strony internetowej dla wyszukiwarek. Plik ten pełni rolę przewodnika dla robotów indeksujących, informując, które sekcje witryny mogą być przeszukiwane, a które powinny zostać pominięte. To narzędzie SEO pozwala optymalizować crawling i indeksowanie, sprzyjając lepszemu pozycjonowaniu w wynikach wyszukiwania Google.

Tworzenie pliku Robots.txt

Krok 1: Utwórz nowy dokument tekstowy. Użyj prostego edytora tekstu, jak Notatnik w systemie Windows lub TextEdit w MacOS, aby utworzyć plik z rozszerzeniem .txt.

Krok 2: Definiowanie zasad dostępu. Pisz instrukcje w formie User-agent i Disallow. Każda zasada powinna być zapisana w nowej linii. Przykład:

User-agent: * Disallow: /prywatna/

To polecenie mówi robotom wszystkich wyszukiwarek (*), że nie mają dostępu do podkatalogu /prywatna/ strony.

Krok 3: Zastosowanie wyjątków. Jeśli chcesz zezwolić określonym botom na dostęp do blokowanej sekcji, użyj dyrektywy Allow. Na przykład:

User-agent: Googlebot Allow: /prywatna/pliki-do-indeksu/ Disallow: /prywatna/

Dzięki temu tylko Googlebot będzie miał dostęp do konkretnych plików w blokowanym katalogu.

Krok 4: Zapisz plik. Nazwij dokument jako robots.txt i zapisz w głównym katalogu witryny, tak aby był on dostępny z poziomu adresu www.przykladowa-strona.pl/robots.txt.

Testowanie poprawności pliku Robots.txt

Po utworzeniu pliku Robots.txt, warto sprawdzić jego poprawność za pomocą dedykowanych narzędzi, jak tester Robots.txt w Google Search Console. To pomoże upewnić się, że instrukcje są prawidłowo zinterpretowane przez roboty wyszukiwarek.

Pamiętaj, żeby regularnie aktualizować plik Robots.txt, zwłaszcza po wprowadzeniu zmian na stronie, które mogą wpływać na to, jakie treści chcesz udostępniać do indeksowania. Zawsze upewnij się, że Twoje instrukcje nie blokują ważnych zasobów, które mogłyby pozytywnie wpłynąć na pozycjonowanie strony.

Najczęstsze błędy w konfiguracji pliku Robots.txt i jak ich unikać

Przekierowywanie robotów do nieistniejących zasobów

Jednym z najczęstszych błędów przy konfiguracji pliku Robots.txt jest przypadkowe wskazanie wyszukiwarkom ścieżki do zasobów, które nie istnieją, lub zostały przeniesione. W efekcie roboty wyszukiwarek napotykają tzw. martwe linki (dead links), co może negatywnie wpłynąć na ocenę jakości Twojej witryny. Aby uniknąć tego błędu, regularnie rewiduj i aktualizuj zawartość pliku Robots.txt, upewniając się, że wszystkie zasoby są dostępne i prawidłowo zindeksowane.

Niewłaściwe wykorzystanie znaku gwiazdki (*)

Właściwe użycie znaku gwiazdki (_) w pliku Robots.txt jest kluczowe dla właściwego zarządzania dostępem robotów. Niestety, często spotykanym błędem jest nadużywanie tego symbolu, co może prowadzić do blokowania więcej treści niż zamierzano. Aby tego uniknąć, koniecznie zapoznaj się z różnicami pomiędzy dzikim znakiem (_) a dokładnym wskazaniem ścieżki (Disallow: /folder/ w przeciwieństwie do Disallow: /folder/*), tak aby wyraźnie kontrolować, które części strony są dostępne dla robotów indeksujących.

Brak instrukcji Allow

Kolejnym elementem, który bywa pomijany, jest użycie dyrektywy Allow w pliku Robots.txt. Jest to przydatne narzędzie w sytuacjach, gdy potrzebujemy zablokować dostęp do pewnego katalogu, ale udostępnić wybrane pliki lub podkatalogi znajdujące się wewnątrz tej zablokowanej ścieżki. Odpowiednie stosowanie dyrektywy Allow w parze z Disallow pozwoli na zwiększenie precyzyjności i elastyczności w zarządzaniu indeksacją Twojej strony.

Niejasne instrukcje blokujące

Nieprecyzyjnie sformułowane instrukcje mogą sprawić, że roboty wyszukiwarek będą miały problem z interpretacją zawartości pliku Robots.txt. Dlatego zawsze formułuj instrukcje w sposób jasny i niewątpliwy, unikając zbyt ogólnych wyrażeń, które mogą być mylące. Upewnij się, że Twoje zasady są spójne i nie nakładają się na siebie, co mogłoby prowadzić do konfliktów interpretacyjnych i nieoczekiwanego zachowania robotów.

Zaniedbywanie testowania pliku Robots.txt

Każda zmiana w pliku Robots.txt powinna być uważnie testowana. Korzystanie z narzędzi do testowania Robots.txt dostępnych w Google Search Console pozwala na sprawdzenie, czy wprowadzone reguły są rozumiane przez roboty tak, jak tego oczekiwałeś. Regularne testy pomogą Ci wyeliminować błędy, które mogłyby niekorzystnie wpłynąć na widoczność Twojej strony w wynikach wyszukiwania.

Pamiętaj, że plik Robots.txt jest jednym z fundamentów SEO – odpowiednio skonfigurowany, staje się potężnym narzędziem, które pomaga w optymalizacji pozycjonowania Twojej witryny w wyszukiwarce Google. Bezpieczne i świadome zarządzanie dostępem robotów, przy unikaniu wyżej wymienionych błędów, może znacząco wpłynąć na poprawę widoczności i osiągane wyniki w wyszukiwarce.

Jakiego oprogramowania użyć do edycji i weryfikacji pliku Robots.txt

Zarządzanie dostępem wyszukiwarek do Twojej strony internetowej za pomocą pliku robots.txt jest kluczowym aspektem optymalizacji dla wyszukiwarek (SEO). Aby efektywnie edytować i weryfikować zawartość tego pliku, warto wykorzystać specjalistyczne oprogramowanie i narzędzia online, które ułatwią zarządzanie i zapewnią, że Twoje ustawienia będą optymalne dla lepszego pozycjonowania w Google.

Narzędzia do Edycji Robots.txt

Edytowanie pliku robots.txt nie wymaga skomplikowanego oprogramowania, jednak zaleca się korzystanie z edytorów tekstowych, które oferują podświetlanie składni oraz sprawdzanie błędów, takich jak Notepad++ czy Sublime Text. Te edytory wyróżniają się wyjątkową funkcjonalnością i pozwalają zachować czystość kodu, co jest niezwykle istotne dla precyzyjnego zarządzania robotami wyszukiwarek.

Narzędzia do Weryfikacji Robots.txt

Z kolei do weryfikacji poprawności pliku robots.txt można wykorzystać Narzędzie do testowania pliku robots.txt dostępne w Google Search Console. To narzędzie online pozwala nie tylko sprawdzić, czy plik jest poprawnie zinterpretowany przez roboty Google’a, ale również przetestować, czy określone strony są zablokowane zgodnie z intencją. Inną przydatną funkcją jest symulowanie, jak Googlebot zindeksuje Twoją stronę na podstawie obecnego pliku robots.txt.

Zaawansowane Opcje dla Profesjonalistów SEO

Specjaliści SEO mogą również korzystać z bardziej zaawansowanych narzędzi takich jak Screaming Frog SEO Spider czy Ryte, które oferują głębszą analizę i wykrywają potencjalne problemy związane z plikiem robots.txt, które mogą negatywnie wpływać na widoczność strony w wyszukiwarce.

Używanie tych narzędzi do precyzyjnego zarządzania dostępem robotów wyszukiwarek pozwoli Ci skutecznie optymalizować stronę pod kątem SEO. Wybór odpowiedniego oprogramowania to ważny krok w optymalizacji strony internetowej, a dokładne ustawienia pliku robots.txt mogą znacząco wpłynąć na jej pozycjonowanie w wynikach wyszukiwania Google.

Rozumienie dyrektyw User-agent i Disallow w pliku Robots.txt

Czym są dyrektywy User-agent i Disallow?

Dyrektywy User-agent i Disallow stanowią fundamenty pliku robots.txt, kluczowego narzędzia w komunikacji między Twoją stroną a robotami wyszukiwarek internetowych. User-agent pozwala określić, do których robotów (np. Googlebot) mają zastosowanie nasze zasady, natomiast Disallow informuje o stronach lub sekcjach, które powinny zostać wykluczone z indeksacji.

Personalizacja dostępu dla różnych robotów

Konfigurując plik robots.txt dla swojej witryny, możesz dostosować reguły dla różnych typów robotów, co jest szczególnie przydatne, jeśli chcemy różnicować dostęp dla robotów od Google, Bing czy innych wyszukiwarek. Dzięki dokładnemu określeniu dyrektywy User-agent, masz kontrolę nad tym, jakie treści są indeksowane, a tym samym wpływasz na SEO i widoczność swojej strony w Google.

Zastosowanie dyrektywy Disallow dla optymalizacji SEO

Wykluczenie niepotrzebnych zasobów za pomocą dyrektywy Disallow jest niezbędne, aby boty wyszukiwarek skupiły się na istotnych treściach. Zablokowanie dostępu do duplikatów stron, sekcji administracyjnych, nieaktualnych artykułów czy prywatnych katalogów, pozwala zmniejszyć obciążenie serwera oraz chroni przed indeksacją niepożądanych treści, co przekłada się na lepsze zarządzanie crawlem i efektywniejsze pozycjonowanie.

Pamiętaj, że dokładne zrozumienie i właściwe użycie dyrektyw User-agent i Disallow w pliku robots.txt jest niezwykle istotne dla widoczności Twojej witryny w wyszukiwarce Google. Poprawna konfiguracja tego pliku zapobiegnie indeksowaniu niechcianych zasobów, pomoże w ochronie prywatności oraz zwiększy efektywność botów wyszukiwarek przy przetwarzaniu Twojej strony, co jest bezpośrednio związane z lepszym pozycjonowaniem Twojej strony internetowej. Zatem zainwestuj czas w dokładne zrozumienie i optymalizację pliku robots.txt – to prosta, ale równocześnie niezmiernie istotna część strategii SEO.

Przykłady prawidłowo skonfigurowanego pliku Robots.txt dla różnych typów stron

Podstawowe zasady konfiguracji Robots.txt

Właściwa konfiguracja pliku Robots.txt jest kluczowa dla optymalizacji działania robotów wyszukiwarek na Twojej stronie internetowej. Aby efektywnie zarządzać dostępem tych robotów, należy zrozumieć, jakie instrukcje i zasady należy implementować w zależności od typu witryny. Pamiętaj, że każdy błąd w pliku Robots.txt może prowadzić do niepożądanych rezultatów, takich jak indeksowanie poufnych danych lub, co gorsza, nieindeksowanie kluczowych treści strony.

Robots.txt dla witryny firmowej

W przypadku stron firmowych, gdzie priorytetem jest maksymalna widoczność w wynikach wyszukiwania, plik Robots.txt powinien zezwalać na indeksowanie większości zasobów. Przykład prawidłowo skonfigurowanego pliku może wyglądać następująco:

User-agent: * Disallow: /polityka-prywatnosci Disallow: /regulamin Disallow: /panel-klienta

Tutaj instrukcje Disallow blokują dostęp do stron, które nie powinny być widoczne w wynikach wyszukiwania, takich jak regulaminy, polityka prywatności czy wewnętrzne paneli użytkownika.

Robots.txt dla sklepów internetowych

Dla sklepów online kluczowe jest, aby roboty nie indeksowały stron, które mogą generować zduplikowaną treść, jak np. strony z parametrami filtrowania produktów. Przykładowy plik Robots.txt wyglądałby tak:

User-agent: * Allow: / Disallow: /_?_ Disallow: /koszyk Disallow: /zamowienie

Znak “*” wykorzystywany przed znakiem zapytania “?” pozwala na blokowanie wszystkich URL-i zawierających parametry. Dodatkowo blokujemy strony związane z procesem zakupowym, które nie powinny być dostępne dla wyszukiwarek.

Robots.txt dla blogów

Blogerzy natomiast często chcą maksymalizować ruch z wyszukiwarek. W ich przypadku, Robots.txt może być bardzo prosty i zezwalać na indeksowanie całej strony:

User-agent: * Disallow:

Zostawienie pustego Disallow instruuje roboty, że wszystkie sekcje bloga są otwarte do indeksowania, co zwiększa szansę jego eksploracji i indeksowania przez wyszukiwarkę.

Pamiętaj, że skuteczne zarządzanie dostępem robotów wyszukiwarkowych do Twojej strony przez plik Robots.txt to potężne narzędzie SEO, które poprawia widoczność Twojej witryny w Google, ale wymaga starannego i przemyślanego podejścia. Unikaj blokowania ważnych dla indeksowania stron, dbaj o aktualność pliku oraz regularnie monitoruj działania robotów za pomocą narzędzi analitycznych dostępnych np. w Google Search Console.

Sitemap w pliku Robots.txt – dlaczego jest to ważne

Podniesienie widoczności strony w wynikach wyszukiwania

Prawidłowo skonfigurowana mapa witryny (sitemap.xml) zadeklarowana w pliku robots.txt jest kluczowym elementem, który umożliwia robotom wyszukiwarki skuteczniejsze skanowanie i indeksowanie zawartości Twojej strony. Wszystko po to, abyś mógł osiągnąć lepszą widoczność w wynikach wyszukiwania Google i tym samym zwiększyć ruch na swojej witrynie internetowej.

Ułatwienie robotom Google dostęp do struktury Twojej strony

Dodanie ścieżki do mapy witryny w pliku robots.txt pozwala robotom Google na szybkie zlokalizowanie tego krytycznego dokumentu XML. Mapa witryny zawiera informacje o strukturze serwisu, częstotliwości aktualizacji poszczególnych sekcji i priorytetach stron, co znacząco pomaga w efektywnym poruszaniu się po Twojej witrynie.

Zwiększanie skuteczności indeksowania

Dzięki wykorzystaniu mapy witryny, wyszukiwarki mogą łatwiej zrozumieć kontekst Twojej strony, co jest szczególnie ważne dla nowych i dynamicznie zmieniających się treści. Wpływa to na szybsze indeksowanie i pojawianie się Twoich stron w wynikach wyszukiwania, co jest niezwykle istotne w procesie SEO.

Porady dotyczące optymalnej integracji Sitemap z Robots.txt

Zaleca się regularne aktualizowanie mapy witryny i upewnienie się, że zawarte są w niej wszystkie istotne URL-e. Należy również sprawdzić, czy plik robots.txt nie zawiera błędów, które mogłyby blokować dostęp do mapy witryny. Usprawnienie komunikacji między Twoją stroną a robotami wyszukiwarek za pomocą mapy witryny może znacząco przyczynić się do poprawy pozycjonowania i zwiększenia widoczności serwisu w internecie.

Pamiętaj, że konfiguracja pliku robots.txt wymaga przemyślanych działań i dokładnej weryfikacji, ponieważ każdy błąd może wpłynąć na sposób, w jaki wyszukiwarki będą traktowały Twoją stronę. Kompleksowe podejście do zarządzania dostępem wyszukiwarek, włącznie z optymalizacją pliku Sitemap, będzie stanowić solidną podstawę dla zaawansowanych strategii SEO, które pomogą Ci osiągnąć sukces w świecie cyfrowym.

Jak sprawdzić, czy plik Robots.txt jest prawidłowo odczytywany przez roboty Google

Wykorzystanie narzędzi Google do weryfikacji pliku Robots.txt

Aby upewnić się, że plik robots.txt jest prawidłowo interpretowany przez roboty Google, skorzystaj z Narzędzia do testowania robots.txt, które znajdziesz w Google Search Console. To nieocenione narzędzie pozwala na sprawdzenie, jak Googlebot „widzi” plik robots.txt na Twojej stronie. Wprowadź adres URL pliku, aby dokonać analizy i otrzymać informacje o ewentualnych błędach czy ostrzeżeniach, które mogą wpływać na indeksowanie strony przez wyszukiwarkę.

Badanie szczegółów indeksowania i wykluczeń

Monitoruj sekcje „Pozwolono” i „Zablokowano”, aby zrozumieć, które ścieżki na Twojej witrynie są dostępne dla robotów Google, a które zostały skutecznie wyłączone z indeksowania. Jest to kluczowe dla SEO, gdyż niepoprawne zablokowanie ważnych stron może prowadzić do ich nieobecności w wynikach wyszukiwania. Z kolei pozostawienie otwartych nieistotnych podstron może prowadzić do ich nadmiernego indeksowania kosztem ważniejszej zawartości.

Diagnostyka informacji o błędach i ostrzeżeniach

Zwracaj uwagę na wszelkie błędy oraz ostrzeżenia wskazane przez Narzędzie do testowania robots.txt. Komunikaty te mogą dotyczyć składni, niedozwolonych dyrektyw czy nieaktualnych ścieżek. Każdy wykryty problem powinien być szybko rozwiązany, aby zoptymalizować dostępność strony dla robotów Google, co bezpośrednio przekłada się na jej obecność w wynikach wyszukiwania.

Podsumowanie i działania naprawcze

Jeśli wykryjesz nieprawidłowości, dokonaj niezbędnych zmian w pliku robots.txt i ponownie przeprowadź test. Upewnij się, że twoje zmiany nie tylko eliminują wcześniej wykryte błędy, ale również sprzyjają lepszemu pozycjonowaniu strony w Google poprzez umożliwienie indeksowania kluczowych zasobów. Pamiętaj, że każda modyfikacja pliku robots.txt powinna być podyktowana świadomą strategią SEO, mającą na celu zwiększenie widoczności Twojej witryny w Google.

Zastosowanie się do powyższych wskazówek zapewni, że plik robots.txt będzie efektywnym narzędziem w dążeniu do lepszego pozycjonowania Twojej strony w wynikach wyszukiwania Google, a każda jego zmiana będzie przemyślaną decyzją wpływającą na poprawę widoczności Twojej strony w sieci.

Testowanie pliku Robots.txt przy pomocy Google Search Console

Optymalizacja Pliku Robots.txt dla Wyszukiwarek

Zaprojektowanie i optymalizacja pliku robots.txt to kluczowy element w zarządzaniu tym, jak roboty wyszukiwarek indeksują Twoją stronę internetową. Upewnij się, że Twój plik robots.txt nie blokuje ważnych zasobów, które powinny być indeksowane, a ograniczenia dotyczą tylko tych obszarów, które chcesz ukryć przed wyszukiwarkami, takich jak panele administracyjne czy sekcje prywatne.

Wykorzystanie Narzędzia do Testowania Robots.txt w Google Search Console

Google oferuje właścicielom stron internetowych narzędzie do testowania pliku robots.txt w swojej Search Console. Aby skorzystać z tego narzędzia, musisz najpierw zweryfikować własność strony w Google Search Console. Następnie w panelu bocznym znajdź sekcję „Stare wersje” i przejdź do „Testera pliku robots.txt”. Tutaj możesz sprawdzić, czy Twoje instrukcje działają poprawnie i czy nie blokują dostępu do ważnych zasobów.

Analiza i Rozwiązywanie Problemów z Robots.txt

Kiedy zaczniesz analizować plik robots.txt za pomocą Google Search Console, zwróć uwagę na wszelkie ostrzeżenia lub błędy, które mogą się pojawić. Błędy mogą wskazywać na to, że pewne strony lub zasoby są blokowane, mimo że ich indeksowanie jest pożądane. Natomiast ostrzeżenia często dotyczą używania składni, która może nie być zrozumiała dla wszystkich robotów wyszukiwarek. Przejrzyj każdy z tych punktów i wprowadź odpowiednie poprawki w pliku robots.txt, aby upewnić się, że wyszukiwarki mają dostęp do treści, na których Ci zależy w kontekście SEO.

Pamiętając o tych wskazówkach, możesz skutecznie zarządzać dostępem wyszukiwarek do swojej strony poprzez plik robots.txt, co przełoży się na lepsze pozycjonowanie Twojej witryny w wynikach wyszukiwania Google. Warto również regularnie przeprowadzać testy po każdej zmianie wprowadzonej w pliku robots.txt, aby upewnić się, że wszystkie zmiany są zrozumiałe dla robotów Google i nie wpływają negatywnie na widoczność Twojej strony w sieci.

Zarządzanie dostępem do wrażliwych danych za pomocą Robots.txt

Tworzenie i optymalizacja pliku Robots.txt dla bezpieczeństwa strony

Kluczowym elementem zabezpieczenia wrażliwych danych na Twojej stronie internetowej jest poprawne skonfigurowanie pliku Robots.txt. Plik ten służy do instruowania robotów wyszukiwarek, które sekcje witryny powinny być indeksowane, a które pomijane. Aby zakomunikować robotom wyszukiwarek, że niektóre obszary są prywatne, należy doprecyzować ścieżki dostępu do tych danych w sekcji „Disallow” pliku Robots.txt. Przykładowo, jeśli przechowujesz wrażliwe dane w katalogu /private/, Twoja dyrektywa powinna wyglądać następująco:

User-agent: * Disallow: /private/

Zapewnienie, że wrażliwe dane nie zostaną przypadkowo wyeksponowane przez wyszukiwarki, jest kluczowe dla ochrony prywatności użytkowników i bezpieczeństwa przedsiębiorstwa.

Monitorowanie wpływu Robots.txt na pozycjonowanie

Regularna weryfikacja pliku Robots.txt pozwala na utrzymanie optymalnego pozycjonowania strony w wynikach wyszukiwania. Wykluczenie z indeksowania zbyt wielu stron lub ważnych treści może niekorzystnie wpłynąć na widoczność strony w Google. Warto korzystać z Google Search Console do monitorowania, jakie strony zostały zaindeksowane, a które zostały zablokowane przez plik Robots.txt. Taki audyt pozwala na szybką reakcję i dostosowanie dyrektyw w pliku Robots.txt, aby maksymalizować widoczność strony w internecie przy jednoczesnym zachowaniu bezpieczeństwa danych.

SEO a ochrona danych – znajdź równowagę

Zarządzanie dostępem robotów wyszukiwarek jest balansowaniem między ochroną danych a efektywnym SEO. Pamiętaj, by nie blokować stron, które mogą przyczynić się do lepszego rankingu i większego ruchu na witrynie. Dla przykładu, blokowanie dostępu do arkuszy stylów (CSS) czy JavaScript (JS) może uniemożliwić Google prawidłowe renderowanie strony, co może negatywnie wpłynąć na pozycjonowanie. Analizuj wydajność swojej witryny i dostosowuj plik Robots.txt w taki sposób, aby wspierał strategię SEO, jednocześnie chroniąc wrażliwe sekcje przed niepożądaną indeksacją.

Zaimplementowanie przemyślanego pliku Robots.txt to cenna inwestycja w integralność Twojej strony oraz jej pozycjonowanie w Google. Upewnij się, że rozumiesz działanie pliku Robots.txt i przekładaj to na praktyczne kroki zabezpieczające Twoją witrynę przed niechcianym dostępem, nie zapominając o optymalizacji pod kątem silników wyszukiwarek.

Optymalizacja pliku Robots.txt dla lepszej crawlability i indexability stron

Zrozumienie roli robots.txt w SEO

Rola pliku robots.txt w kontekście SEO jest nieoceniona. Jest to pierwszy plik, na który zwracają uwagę roboty indeksujące stronę, takie jak Googlebot. Przez świadome zarządzanie tym plikiem możemy skutecznie wpływać na crawlability (zdolność do przeszukiwania) i indexability (możliwość indeksowania) naszej strony internetowej, co ma bezpośredni wpływ na jej pozycjonowanie w wynikach wyszukiwania Google.

Jak poprawnie skonfigurować plik Robots.txt?

Kluczowe znaczenie dla poprawnego pozycjonowania ma stworzenie jasnych instrukcji dla robotów wyszukiwarek. Plik Robots.txt powinien zostać ustawiony tak, aby zezwalał na indeksowanie ważnych stron, jednocześnie blokując sekcje, które mogą być zbędne dla Google, takie jak panel administracyjny, duplikaty stron czy niepublikowane treści. Pamiętaj, aby używać dyrektyw Disallow i Allow z rozwagą, aby nie wykluczyć przypadkiem strategicznych zasobów.

Optymalizacja dostępu do zasobów ważnych dla SEO

W pliku robots.txt można wykorzystać dyrektywę Sitemap, która poinformuje roboty o lokalizacji mapy witryny (sitemap). Dzięki temu zwiększa się szansę na lepsze zindeksowanie strony. Upewnij się, że wszystkie ważne strony są dostępne dla robotów Google, a te mniej istotne nie są przez nie trawersowane zbyt często, co może obciążać serwer i spowalniać indeksowanie najcenniejszych treści.

Zapobieganie powszechnym błędom w pliku Robots.txt

Wiele stron internetowych cierpi z powodu błędów w pliku robots.txt, które powstają z braku wiedzy i nieuwagi. Aby Twoja strona była optymalnie indeksowana, unikaj blokowania dostępu do plików CSS i JavaScript, ponieważ mogą one być potrzebne Google do prawidłowego renderowania strony. Również wytyczne Google sugerują, żeby nie blokować tych zasobów. Ponadto, upewnij się, że składnia pliku jest poprawna – błąd w jednej linii może spowodować nieprzewidywalne zachowania robotów wyszukiwarek.

Prawidłowo skonfigurowany plik robots.txt to bezcenny składnik strategii SEO, który pozwala na maksymalne wykorzystanie potencjału crawlowania i indeksowania witryny przez Google. Pamiętając o powyższych wskazówkach, możesz zwiększyć widoczność swojej strony w Internecie i tym samym przyczynić się do jej lepszego pozycjonowania w wynikach wyszukiwania.

Znaczenie pliku Robots.txt w kontekście SEO technicznego

Podstawy Optymalizacji z Użyciem Robots.txt

Plik Robots.txt jest niezwykle ważny dla każdej strony internetowej, ponieważ umożliwia właścicielom witryn komunikację z robotami indeksującymi. Aby skutecznie zarządzać dostępem wyszukiwarek do Twojej strony, musisz zrozumieć, jak prawidłowo skonfigurować ten plik. Zoptymalizowany plik robots.txt pozwoli na uniknięcie indeksowania niechcianych zasobów, co przyczyni się do lepszego pozycjonowania w Google.

Tworzenie Efektywnego Pliku Robots.txt

Wykluczenie zbędnych sekcji strony powinno być pierwszym krokiem w konfiguracji pliku robots.txt. Stosuje się w tym celu dyrektywę Disallow, aby zapobiec dostępowi do konkretnych katalogów lub plików. Jednak pamiętaj, aby dokonać tego rozważnie, gdyż błędne użycie może prowadzić do pominięcia przez wyszukiwarki ważnych treści. Używanie prostych, ale precyzyjnych instrukcji zapewni robotom Google jasne wskazówki, które poprawią wydajność indeksowania Twojej witryny.

Poprawna Struktura i Zastosowanie Pliku

Zarządzanie dostępem do zasobów jest kluczowe. Plik robots.txt powinien znaleźć się w głównym katalogu serwisu, co ułatwi robotom wyszukiwarek szybkie odnalezienie i przetworzenie jego zawartości. Dodatkowo, warto wiedzieć, kiedy użyć dyrektywy Allow – może ona służyć do wyraźnego zezwolenia na indeksowanie wybranych części strony, które są dostępne także w sekcjach zablokowanych ogólną dyrektywą Disallow.

Użycie Sitemaps w Pliku Robots.txt

Wskaż wyszukiwarkom lokalizację sitemapy, dodając do pliku robots.txt ścieżkę do pliku sitemap.xml – to znacząco usprawni proces indeksowania. Sitemap to lista URL-i dostępnych dla indeksacji, co ułatwia robotom Google szczegółowe zrozumienie struktury Twojej strony. Skuteczne wykorzystanie Sitemaps w połączeniu z odpowiednio skonfigurowanym plikiem robots.txt może znacząco wpłynąć na poprawę widoczności strony w wynikach wyszukiwania.

Pamiętając o wyżej wymienionych aspektach, możemy konkludować, że umiejętne zarządzanie dostępem wyszukiwarek za pomocą pliku robots.txt odgrywa kluczową rolę w SEO technicznym. Wdrażanie najlepszych praktyk związanych z plikiem robots.txt zwiększa szanse na lepsze pozycjonowanie strony, poprawiając tym samym jej widoczność w sieci.

Jak Robots.txt wpływa na szybkość indeksowania strony przez Google

Zrozumienie funkcji pliku Robots.txt

Plasz robots.txt odgrywa kluczową rolę w procesie zarządzania dostępem robotów wyszukiwarek do zawartości Twojej strony internetowej. Jest to pierwszy plik, z którym robot wyszukiwarki się zapoznaje, wchodząc na Twoją domenę. Poprzez precyzyjne wytyczne zawarte w tym pliku, możesz wpłynąć na szybkość i zakres indeksowania Twojej witryny przez Google, co bezpośrednio przekłada się na jej widoczność i pozycjonowanie.

Doskonała praktyka w konfiguracji Robots.txt

Aby skutecznie zarządzać procesem indeksowania, ważne jest, aby znać najlepsze techniki tworzenia i zarządzania plikiem robots.txt. Nieprawidłowa konfiguracja może prowadzić do niezamierzonego blokowania wartościowych stron przed indeksowaniem, co z kolei może negatywnie wpłynąć na SEO. Z kolei dobrze skonfigurowany plik robots.txt przyczynia się do szybszego przetwarzania przez Googlebot ważnych sekcji witryny, co zwiększa szanse na lepsze pozycjonowanie w wynikach wyszukiwania.

Optymalne użycie dyrektyw

Wykorzystanie dyrektyw takich jak „Allow” i „Disallow” pozwala na szczegółowe sterowanie tym, które części strony mają być skanowane, a które pomijane przez roboty wyszukiwarki. Dzięki temu możesz skoncentrować uwagę Googlebot na najważniejszych zasobach, jednocześnie ograniczając jego działanie w obszarach mniej istotnych, takich jak strony z duplikowaną treścią lub panele administracyjne.

Skutki ignorowania pliku Robots.txt

Ignorowanie wagi pliku robots.txt lub popełnianie błędów w jego konfiguracji może prowadzić do przedłużenia czasu niezbędnego na indeksowanie strony lub nawet całkowite wykluczenie niektórych jej elementów z indeksu Google. Istotne jest regularne monitorowanie i dostosowywanie ustawień robots.txt, aby były zgodne z bieżącymi celami SEO.

Podsumowanie kluczowych korzyści

Plik robots.txt jest potężnym narzędziem w rękach specjalistów SEO, które w odpowiednich rękach może znacząco poprawić efektywność indeksowania. Pamiętaj, że optymalna konfiguracja tego pliku to sposób na zapewnienie, że najcenniejsze treści Twojej witryny będą miały priorytet w oczach Googlebot, co jest fundamentem dobrego pozycjonowania w Google. Dzięki temu, nie tylko poprawiasz widoczność swojej strony, ale również przyczyniasz się do lepszego doświadczenia użytkowników odwiedzających Twoją witrynę za pośrednictwem wyszukiwarki.

Plik Robots.txt a linki nofollow i noindex – zrozumienie różnic

Kluczowym aspektem optymalizacji strony internetowej pod kątem SEO jest zrozumienie roli, jaką odgrywają pliki robots.txt, linki nofollow oraz metatagi noindex w zarządzaniu dostępem wyszukiwarek do treści na Twojej stronie. Aby poprawić swoje pozycjonowanie w Google, musisz wiedzieć, jak wykorzystać te narzędzia do swojej korzyści.

Czym jest plik robots.txt?

Plik robots.txt to pierwsze, z czym roboty indeksujące (np. Googlebot) mają kontakt, wchodząc na stronę. Jest to plik tekstowy umieszczony w głównym katalogu witryny, który informuje roboty, jakie sekcje witryny powinny być wykluczone z indeksowania. Ważne jest, aby pamiętać, że robots.txt nie gwarantuje całkowitego ignorowania zawartości przez roboty, ponieważ jest to zaledwie sugestia, a nie wymóg.

Jak funkcjonują linki nofollow i metatagi noindex?

Zarówno linki nofollow, jak i metatagi noindex są wykorzystywane do sterowania indeksem wyszukiwarek, lecz w różny sposób. Link nofollow umiejscowiony w atrybucie rel tagu mówi wyszukiwarkom, aby nie przekazywały wartości SEO, czyli nie śledziły linków wychodzących. Natomiast metatagi noindex umieszczone w sekcji strony, instruują roboty, aby całkowicie pominęły stronę podczas indeksowania.

Wykorzystanie pliku robots.txt dla lepszego SEO

Aby skutecznie zarządzać dostępem wyszukiwarek do Twojej strony, rozważ następujące strategie wykorzystania pliku robots.txt:

– Ogranicz dostęp do mniej ważnych sekcji Twojej witryny, aby wyszukiwarki skupiły się na priorytetowych treściach.

– Unikaj blokowania zasobów takich jak CSS i JavaScript, które są potrzebne do prawidłowego renderowania strony.

– Regularnie aktualizuj plik robots.txt, aby odzwierciedlał zmiany struktury witryny i nowe wytyczne SEO.

Pamiętaj, że dobre zarządzanie plikiem robots.txt może przyczynić się do bardziej efektywnego indeksowania strony i polepszyć Twoje pozycjonowanie w wynikach wyszukiwania Google. Wykorzystanie mechanizmów nofollow i noindex powinno być przemyślane i dostosowane do indywidualnych celów SEO Twojej witryny.

Podsumowując, zrozumienie różnic między plikiem robots.txt, linkami nofollow i metatagami noindex jest niezbędne dla każdego webmastera pragnącego zoptymalizować swoją stronę dla wyszukiwarek. Właściwe wykorzystanie tych narzędzi pozwoli Ci lepiej zarządzać treścią dostępną dla robotów indeksujących i poprawić widoczność strony w wynikach wyszukiwania.

Wpływ nieprawidłowo skonfigurowanego pliku Robots.txt na ruch organiczny

Podstawowe zasady konfiguracji Robots.txt

Kluczowym elementem efektywnej obecności w Internecie jest prawidłowo skonfigurowany plik Robots.txt, który ma bezpośredni wpływ na pozycjonowanie strony w wyszukiwarce Google. Jest to plik tekstowy, który informuje roboty wyszukiwarki, które sekcje witryny mogą być indeksowane, a które powinny zostać pominięte. Błędna konfiguracja tego pliku może prowadzić do ukrycia cennego contentu przed wyszukiwarkami lub, co gorsza, do zablokowania dostępu do całej strony.

Znaczenie Robots.txt dla SEO

Robots.txt odgrywa istotną rolę w SEO, ponieważ pozwala administratorom stron na kierowanie robotów Google do najważniejszych sekcji witryny. Nieprawidłowe użycie dyrektyw, takich jak Disallow czy Allow, może skutkować zaniżonym rankingiem strony – przez co ruch organiczny może znacząco spaść. Jest to związane z ograniczeniem możliwości indeksowania przez roboty treści, które są wartościowe dla potencjalnych odwiedzających i mogą generować naturalny ruch.

Jak unikać błędów w Robots.txt?

Aby zapobiec błędom, które negatywnie wpływają na widoczność w wyszukiwarce, należy stosować się do najlepszych praktyk zarządzania plikiem Robots.txt. Przede wszystkim, dokładnie przemyśl, które części strony chcesz wykluczyć z indeksowania. Upewnij się, że nie blokujesz dostępu do plików JS i CSS, które pomagają Google zrozumieć i prawidłowo renderować Twoją stronę. Regularnie aktualizuj i audytuj plik Robots.txt, aby wyeliminować przestarzałe lub błędne wpisy, które mogą wejść w konflikt z optymalizacją SEO.

W konkluzji, inteligentne zarządzanie plikiem Robots.txt jest niezbędne dla maksymalizacji ruchu organicznego i osiągnięcia lepszej pozycji w Google. Wszelkie modyfikacje powinny być przemyślane i bazować na dokładnej analizie potrzeb SEO witryny. Pamiętaj, że nawet najdrobniejszy błąd w Robots.txt może mieć nieproporcjonalnie duży wpływ na Twoją widoczność w sieci.

Plik Robots.txt a kanibalizacja słów kluczowych – jak unikać błędów

Czym jest kanibalizacja słów kluczowych i dlaczego należy jej unikać?

Kanibalizacja słów kluczowych występuje, gdy wiele stron na Twojej witrynie konkuruję o te same lub bardzo podobne frazy kluczowe. To błędne koło może znacząco obniżyć wartość SEO każdej ze stron i zaburzyć optymalizację witryny. Aby unikać takiego scenariusza, konieczne jest inteligentne zarządzanie plikiem robots.txt, które pozwala efektywnie kierować roboty wyszukiwarek i zwiększać widoczność najważniejszych contentów w wynikach wyszukiwania Google.

Jak plik robots.txt wpływa na kanibalizację słów kluczowych?

Plik robots.txt, będący podstawą komunikacji z robotami indeksującymi, może pomóc zapobiegać kanibalizacji słów kluczowych poprzez blokowanie dostępu do mniej ważnych lub duplikowanych treści. Umożliwia to skoncentrowanie 'siły’ SEO na stronach, które chcemy promować najbardziej. Kluczowe jest więc zdefiniowanie, które sekcje witryny powinny być wykluczone z indeksowania, aby nie konkurowały o te same zapytania z kluczowymi podstronami.

Praktyczne wskazówki dotyczące optymalizacji robots.txt

Po pierwsze, przeprowadź audyt SEO aby zidentyfikować problemy z kanibalizacją. Następnie, wykorzystaj plik robots.txt by wyraźnie wskazać Google, które strony mają być indeksowane, a które nie. Pamiętaj, aby korzystać z dyrektyw Disallow z umiarem i świadomością – zbyt szerokie blokowanie może przynieść więcej szkody niż pożytku. Używaj narzędzia Google Search Console, aby regularnie monitorować, jak roboty interpretują Twój plik robots.txt i dostosowywać zawartość w zależności od efektów.

Odrobina wiedzy e-commerce może przydać się, gdy zarządzasz sklepem online – blokując dostęp do duplikowanych kart produktów, zwiększasz szanse, że to właśnie główna kategoria będzie rankować wysoko w Google. Nie zapomnij również o aktualizacji pliku sitemap.xml, który powinien zawierać tylko te strony, które chcesz promować w wynikach wyszukiwania.

Niezwykle istotne jest również prowadzenie konsolidacji słów kluczowych, a więc grupowanie podobnych treści i optymalizacja na różnych poziomach witryny, aby uniknąć wewnętrznej konkurencji na te same frazy. Twoje działania powinny być zawsze w pełni świadome i podyktowane strategią SEO, która wspiera wzrost widoczności strony i jej pozycjonowanie w Google.

Uaktualnianie pliku Robots.txt w odpowiedzi na zmiany algorytmów Google

Dlaczego aktualizacja Robots.txt jest kluczowa?

Aktualizacja pliku robots.txt jest fundamentalna dla utrzymania właściwej komunikacji między Twoją stroną a wyszukiwarkami, szczególnie w świetle ciągłych aktualizacji algorytmów Google. Ten prosty plik tekstowy ma ogromne znaczenie dla SEO, ponieważ informuje roboty wyszukiwarek, które sekcje witryny mają być indeksowane, a które powinny pozostać nieprzeszukiwane.

Monitorowanie zmian w algorytmach

Zrozumienie, kiedy i jak dostosować plik robots.txt do bieżących zmian algorytmów Google, wymaga cyklicznego monitorowania ogłoszeń wydawanych przez Google oraz śledzenie trendów SEO. Strony takie jak 'Google Search Central Blog’ czy dedykowane fora SEO stają się w tej sytuacji bezcennymi źródłami wiedzy. Modyfikacje robione w odpowiedzi na aktualizacje algorytmów mogą znacząco wpłynąć na to, jak szybko i jak efektywnie Twoja strona będzie się pozycjonować.

Adaptacyjne zarządzanie plikiem Robots.txt

Adaptacyjne zarządzanie plikiem robots.txt polega na optymalizacji dostępu robotów do zasobów strony w taki sposób, by maksymalizować jej widoczność w SERP (ang. Search Engine Results Pages). Kluczowe jest, aby ekskluzywne treści były łatwo dostępne dla robotów Google, a te mniej wartościowe (takie jak skrypty, style CSS czy strony o wysokiej duplikacji treści) były odpowiednio ograniczone. Użycie dyrektyw Disallow, Allow czy Sitemap, powinno być przemyślaną strategią, a nie przypadkowym zestawem reguł.

Przeprowadzanie regularnych audytów pliku Robots.txt

Regularne audyty pliku robots.txt pozwalają na identyfikację obszarów wymagających ulepszeń oraz zapobiegają przypadkowym blokadom dostępu do istotnych dla Google i użytkowników sekcji strony. Warto korzystać z narzędzi Google Search Console, które oferują funkcje testowania pliku robots.txt, umożliwiając sprawdzenie jego wpływu na indeksowanie strony. Zmiany wprowadzane na podstawie audytów powinny być konsekwentne z celami SEO i skuteczne w kontekście obecnego algorytmu wyszukiwarki.

Konsultacje ze specjalistami SEO

W przypadku jakichkolwiek wątpliwości dotyczących optymalnego ustawienia pliku robots.txt, warto zasięgnąć opinii ekspertów SEO, którzy na podstawie swoich doświadczeń i bieżącej wiedzy, mogą doradzić najlepsze praktyki odpowiadające na aktualne wymagania Google. Profesjonalne doradztwo może być różnicą pomiędzy stroną dobrze widoczną w wyszukiwarce a taką, która nie wykorzystuje w pełni swojego potencjału.

Pamiętaj, że umiejętne zarządzanie plikiem robots.txt, szczególnie w dobie częstych aktualizacji algorytmów wyszukiwarek, jest równie ważne jak produkcja wartościowego contentu czy budowanie linków. To często niedoceniany element SEO, który jednak ma niemałe znaczenie dla efektywności Twojej strategii marketingowej online.

Case study: sukcesy i porażki w zarządzaniu plikiem Robots.txt na przykładzie stron internetowych

Profesjonalne podejście do pliku Robots.txt jako klucz do SEO

Prawidłowo skonfigurowany plik Robots.txt to nieodzowny element optymalizacji strony dla wyszukiwarek (SEO). Przykłady wielu witryn pokazują, że umożliwia on kontrolowanie tego, które części serwisu są indeksowane przez roboty Google, a które pozostają niewidoczne. Rozsądne zarządzanie tym plikiem może przyczynić się do zwiększenia widoczności wartościowych treści i wyeliminowania problemów z duplikacją contentu, co jest szczególnie istotne w oczach algorytmów Google.

Związki pomiędzy Robots.txt a wydajnością strony

Sukcesy na polu zarządzania Robots.txt często korelują z lepszą wydajnością witryny w wynikach wyszukiwania. Dzięki odpowiedniemu ustawieniu dyrektyw, takich jak „Allow” i „Disallow”, można zarządzać budżetem crawlowania, co jest niezmiernie ważne dla dużych portalów z setkami podstron. Przypadki, gdzie witryny nie brały pod uwagę ograniczeń crawl budget, często skutkowały pomijaniem przez roboty wyszukiwarki najważniejszych, świeżo opublikowanych treści.

Case study: Efektywne wykorzystanie pliku Robots.txt

Praktyczne przykłady dobrze zarządzanych stron pokazują, że dokładna selekcja zasobów do indeksacji potrafi znacząco poprawić pozycjonowanie. Strony, które wyłączyły z indeksacji duplikaty, strony o niskiej wartości lub panel administracyjny, mogły pochwalić się wzrostem ruchu organicznego. Co więcej, eliminacja zbędnych zasobów z procesu indeksacji skutkowała wzrostem skuteczności i szybkości indeksowania wartościowych treści.

Błędy w pliku Robots.txt i ich negatywny wpływ na SEO

Porażki w zarządzaniu plikiem Robots.txt są równie pouczające. Przypadki, kiedy przez nieumyślne wykorzystanie dyrektywy „Disallow” zablokowano dostęp do kluczowych zasobów strony, prowadziły do znaczącego spadku widoczności w wynikach wyszukiwania. Błędne blokady sekcji witryn, takie jak kategorie produktów w sklepach internetowych, generowały spadek sprzedaży i obniżały jakość doświadczeń użytkowników.

Wnioski i najlepsze praktyki w zarządzaniu Robots.txt

Zarówno sukcesy, jak i porażki w zarządzaniu plikiem Robots.txt dostarczają cennych wniosków. Kluczem do sukcesu jest dokładna analiza i regularne audyty tego pliku, aby upewnić się, że wszystkie ważne zasoby są dostępne dla robotów indeksujących, a te nieistotne wykluczone z procesu. Należy także pamiętać o poprawnej składni i testowaniu zmian za pomocą narzędzi Google dla webmasterów, które pozwalają przewidzieć ewentualne skutki modyfikacji. Praktyczne lekcje z case studies stanowią bezcenne źródło wiedzy, które pomoże unikać podobnych błędów i osiągnąć lepszą pozycję strony w wyszukiwarce.

Plik Robots.txt a bezpieczeństwo Twojej strony internetowej

Definicja i zastosowanie pliku robots.txt

Plik robots.txt jest to standardowy plik tekstowy używany przez administratorów stron internetowych do zarządzania dostępem robotów i botów wyszukiwarek do określonych sekcji witryny. Korzystając z dyrektyw Disallow i Allow, można skutecznie ukierunkować działanie robotów indeksujących, ograniczając ich dostęp do poufnych danych lub nieważnych dla indeksowania obszarów. To sprawia, że plik ten ma kluczowe znaczenie dla bezpieczeństwa oraz optymalizacji SEO.

Bezpieczeństwo strony a wykluczenia w pliku robots.txt

Należy pamiętać, że plik robots.txt nie jest narzędziem do zapewnienia pełnego bezpieczeństwa, ale może przyczynić się do zmniejszenia ekspozycji wrażliwych materiałów. Poprawnie skonfigurowany plik robots.txt zapobiega wyświetlaniu w wynikach wyszukiwania stron, które zawierają poufne informacje, takie jak panel administracyjny czy dane użytkowników. Ważne jest, aby nie polegać wyłącznie na tym pliku jako na środku ochrony przed nieautoryzowanym dostępem, a jedynie traktować go jako wstępną linię obrony.

Optymalne ustawienia robots.txt dla lepszego pozycjonowania

Dla osiągnięcia najlepszych wyników w wyszukiwarkach, plik robots.txt powinien zostać zdefiniowany tak, aby ułatwić robotom Google indeksowanie wartościowych treści, jednocześnie wykluczając strony o małej wartości SEO. Użyj dyrektywy Disallow do blokowania dostępu do duplikatów treści, struktur strony pomocniczych oraz formatów plików, które nie przyczyniają się do rankingu strony. Korzystanie z mapy witryny (Sitemap) w połączeniu z plikiem robots.txt może znacząco przyspieszyć i usprawnić proces indeksowania przez Google.

Monitorowanie i aktualizacja pliku robots.txt

Regularna analiza i aktualizacja pliku robots.txt jest niezbędna dla utrzymania optymalnego pozycjonowania oraz bezpieczeństwa strony internetowej. W celu monitorowania skuteczności pliku robots.txt, wykorzystaj Narzędzia dla webmasterów Google, które pozwalają na sprawdzanie stanu indeksacji, a także identyfikację i rozwiązywanie problemów związanych z robots.txt. Pamiętaj o testowaniu zmian przed wdrożeniem, aby uniknąć przypadkowego zablokowania ważnych stron dla robotów.

Jak zdobyć przewagę nad konkurencją dzięki lepszemu zarządzaniu plikiem Robots.txt

Optymalizacja zawartości pliku Robots.txt dla wyszukiwarek

Tworząc plik Robots.txt, warto pamiętać, że jego właściwa konfiguracja może znacznie wpłynąć na widoczność strony w wynikach wyszukiwania Google. Pierwszym krokiem jest ustalenie, które sekcje witryny mają być dostępne dla robotów indeksujących, a które powinny zostać ukryte, aby zapobiec rozproszeniu wartości SEO. Zastosuj odpowiednie dyrektywy, takie jak „Disallow” lub „Allow”, z precyzją dopasowaną do struktury Twojej witryny, co pozwoli na większą kontrolę nad tym, które zasoby są indeksowane.

Wykorzystanie pliku Sitemap w połączeniu z Robots.txt

Współpraca pliku Robots.txt z mapą witryny (Sitemap) jest kluczowa dla efektywnego pozycjonowania. Upewnij się, że w pliku Robots.txt zawarte jest odniesienie do pliku Sitemap.xml za pomocą dyrektywy „Sitemap”, co ułatwia robotom Google odnalezienie i zindeksowanie najważniejszych stron. Dzięki temu zoptymalizujesz proces crawlowania strony, a co za tym idzie, osiągniesz lepsze wyniki w wyszukiwarek.

Dynamiczne ajustowanie dostępu do witryny

Stałe monitorowanie i aktualizacja pliku Robots.txt to działania konieczne do utrzymania optymalnego stanu witryny. Sprawdzaj regularnie logi serwera, aby upewnić się, że wyszukiwarki mają dostęp do właściwych zasobów, a także aby zidentyfikować potencjalne błędy, takie jak niechciane zablokowania. Elastyczne dostosowywanie polityki pliku Robots.txt w odpowiedzi na zmiany algorytmów wyszukiwarek pozwoli Ci zachować krok przed konkurencją.

Zabezpieczenie przed nadmiernym obciążeniem serwera

Optymalizacja pliku Robots.txt nie tylko wpływa na SEO, ale również na wydajność serwera. Wykorzystaj dyrektywę „Crawl-delay”, aby określić, jak często robot wyszukiwarki może odwiedzać Twoją stronę bez ryzyka wywołania zbyt dużego obciążenia. To istotne szczególnie dla stron z bogatym kontentem lub ograniczoną mocą serwerową, gdzie szybkość odpowiedzi witryny może wpływać na ogólną ocenę strony przez Google.

Wykluczenie poufnych treści

Zapewnienie bezpieczeństwa informacji jest nie mniej istotne niż samo SEO. Wykorzystaj plik Robots.txt, by wykluczyć z indeksowania strony zawierające poufne dane lub te, które z innych powodów nie powinny być publicznie dostępne. Pamiętaj, że robots.txt jest plikiem publicznym, dlatego bezpieczniejsze metody ograniczania dostępu, takie jak stosowanie metatagu „noindex” lub autoryzacja hasłem, mogą być tutaj bardziej odpowiednie dla ochrony wrażliwych danych.

Poznawanie i dostosowywanie do wymagań wyszukiwarek

Regularne śledzenie zmian w algorytmach i polityce Google, a także bieżące dostosowywanie pliku Robots.txt do tych zmian, może dać Ci znaczącą przewagę nad konkurentami. Obserwuj trendów SEO i aktualizacje narzędzi webmasterów, aby wykorzystać każdą możliwość poprawy pozycjonowania strony.

Stosuj się do tych wytycznych, a zauważysz, jak lepsze zarządzanie plikiem Robots.txt przekłada się na zwiększenie widoczności Twojej strony w Google, co jest równoznaczne z uzyskaniem przewagi nad konkurencją w walce o najwyższe pozycje w wynikach wyszukiwania.

Najlepsze praktyki w zarządzaniu dostępem robotów do strony przy użyciu pliku Robots.txt

Zrozumienie roli i funkcji pliku Robots.txt

Plażowy plik Robots.txt stanowi podstawę dialogu pomiędzy Twoją stroną a wyszukiwarkami, takimi jak Google. Poprzez staranne skonfigurowanie tego pliku, możesz instruować roboty indeksujące, które części serwisu powinny być skanowane, a które pozostają zamknięte dla ich uwagi, co bezpośrednio przekłada się na skuteczność pozycjonowania.

Optymalizacja pliku Robots.txt dla pozycjonowania

Podczas tworzenia lub edytowania pliku Robots.txt, zacznij od zdefiniowania sekcji User-agent, aby precyzyjnie określić, którzy roboty są adresaci twoich instrukcji. Disallow i Allow to dwie podstawowe dyrektywy, które nakreślą granice dostępu. Na przykład, użycie „Disallow: /images/” zapobiega indeksowaniu katalogu obrazów, co może być pożądane, jeśli nie chcesz, aby fotografie były widoczne w wyszukiwarkach. Ważne jest jednak, aby nie blokować dostępu do plików CSS i JS, które są istotne dla prawidłowego rozumienia i renderowania strony przez Googlebot.

Balans między dostępem a ochroną prywatności

O ile ważne jest dopuszczenie robotów do treści, które mają być widoczne w wynikach wyszukiwania, o tyle istotne jest ochronienie wrażliwych danych. Sekcje takie jak panel administracyjny czy informacje poufne mogą być wykluczone dzięki zastosowaniu dyrektyw Disallow, dzięki czemu zwiększasz bezpieczeństwo serwisu nie ryzykując jednocześnie SEO.

Testowanie i monitorowanie wpływu pliku Robots.txt na indeksację

Istotnym krokiem jest weryfikacja, czy wprowadzone zmiany przynoszą oczekiwane efekty. Narzędzia takie jak Google Search Console pozwalają na testowanie pliku Robots.txt i identyfikację problemów z indeksacją. Regularny monitoring i dostosowywanie pliku do zmieniających się potrzeb strony oraz wytycznych Google, pozwala na utrzymanie optymalnej widoczności serwisu w sieci.

Pamiętaj, że wykorzystanie pliku Robots.txt to proces wymagający dozoru i ciągłej optymalizacji. Dzięki przestrzeganiu wyżej wymienionych zasad, twój serwis może uzyskać lepsze wyniki w wyszukiwarkach, co przełoży się na jego ogólny sukces w internecie.

Robots.txt dla sklepów internetowych – specyficzne wytyczne

Zrozumienie funkcji pliku robots.txt

Podstawą skutecznego zarządzania dostępem wyszukiwarek do witryny e-commerce jest dogłębne zrozumienie funkcji pliku robots.txt. Jest to prosty tekstowy plik konfiguracyjny, który mówi robotom indeksującym (takim jak Googlebot), które sekcje strony internetowej mają być skanowane, a które pomijane. Ustawienia te mają bezpośredni wpływ na pozycjonowanie stron w wyszukiwarkach, dlatego krytyczne jest ich odpowiednie skonfigurowanie.

Wykluczanie nieistotnych zasobów

Strategiczne wykluczenie z indeksowania nieistotnych dla użytkownika zasobów może przyspieszyć indeksowanie kluczowych treści. W przypadku sklepów online warto zatem użyć pliku robots.txt do blokowania stron takich jak koszyk, regulamin czy polityka prywatności, które nie wnoszą wartości SEO. Przez ograniczenie dostępu do mniej istotnych sekcji, skierujemy uwagę robotów indeksujących na produkty i kategorie – serce działalności e-commerce.

Optymalizacja z wykorzystaniem dyrektyw

Wykorzystując dyrektywy takie jak „Disallow” czy „Allow” można precyzyjnie kontrolować, które części strony są eksplorowane przez roboty. W przypadku sklepów internetowych ważne jest, aby zablokować dostęp do stron z duplikowaną treścią, np. różne wersje URL prowadzące do tej samej strony produktu. Obejmuje to również parametry URL, które są generowane przez filtry – ich indeksowanie może prowadzić do rozwadniania wartości SEO i tworzenia „pułapek indeksowania”.

Zachowanie równowagi między dostępnością a ochroną

Zbyt restrykcyjny plik robots.txt może niepotrzebnie ograniczyć widoczność strony w wynikach wyszukiwania. Sklepy online powinny więc dążyć do zachowania równowagi, pozwalając na indeksowanie istotnych treści, jednocześnie chroniąc te, których widoczność może negatywnie wpłynąć na pozycjonowanie serwisu lub bezpieczeństwo danych. Szczególną uwagę warto poświęcić ochronie przed dostępem do katalogów zawierających poufne informacje.

Monitorowanie i Analiza

Po skonfigurowaniu pliku robots.txt, zasadnicze jest regularne monitorowanie i analiza jego skuteczności. Narzędzia takie jak Google Search Console pozwalają sprawdzić, jak roboty Google traktują plik robots.txt i które strony są skanowane lub pomijane. Analiza ta powinna być częścią strategii SEO każdego sklepu internetowego, aby upewnić się, że plik robots.txt wspomaga osiąganie celów biznesowych, a nie staje się nieoczekiwaną przeszkodą.

Monitorowanie efektów zmian w pliku Robots.txt na pozycję w wyszukiwarce

Zarządzanie dostępem robotów wyszukiwarek do treści na stronie internetowej za pomocą pliku robots.txt jest kluczową kwestią w kontekście SEO. Wdrażając zmiany w tym pliku, należy z rozwagą śledzić ich wpływ na pozycjonowanie strony. Monitorowanie tych efektów pozwoli na szybką reakcję i dostosowanie strategii SEO w celu maksymalizacji widoczności Twoich treści w wynikach wyszukiwania Google.

Jak prowadzić efektywny monitoring?

- Wykorzystaj narzędzia Google: Google Search Console oferuje szeroki wachlarz funkcji pozwalających zobaczyć, jak zmiany w pliku

robots.txtwpływają na indeksację strony. Sekcja „Pokrycie” pozwoli Ci zidentyfikować strony zablokowane przez plikrobots.txt, a także śledzić, jak te zmiany przełożą się na ilość wejść na stronę. - Obserwuj ruch organiczny: Użyj narzędzi analitycznych, by śledzić ruch przychodzący do Twojej witryny, zwłaszcza ze źródeł organicznych. Spadek odwiedzin może sygnalizować nadmierne ograniczenie dostępu dla robotów wyszukiwarki.

- Przeprowadzaj testy A/B: Jeżeli wprowadzasz większe zmiany, rozważ przeprowadzenie testów A/B, by porównać efekty zmian na części witryny, która będzie korzystać z nowego pliku

robots.txt, z efektami dla reszty strony.

Analityka i strategia dostosowana do celów SEO

Znaczenie monitoringu pozycji w wyszukiwarce po zmianach w pliku robots.txt nie ogranicza się jedynie do obserwacji krótkoterminowych efektów. Długofalowa analiza pozwala na wypracowanie optymalnej strategii zarządzania treścią dostępną dla robotów indeksujących, co wpływa nie tylko na pozycjonowanie, ale również na ogólną widoczność strony w sieci. Regularne przeglądy pliku robots.txt w kontekście zmieniających się algorytmów Google i dostosowywanie go do aktualnych wytycznych SEO, to podstawa dla efektywnej obecności online i osiągania zakładanych celów marketingowych.

Podsumowując, kluczowe jest, aby monitoring efektów zmian w pliku robots.txt był traktowany jako proces ciągły. Tylko w ten sposób można efektywnie reagować na dynamikę algorytmów wyszukiwarek i utrzymywać witrynę w topowych wynikach wyszukiwania. Przemyślane zarządzanie dostępem robotów to fundament w budowaniu silnej i stabilnej pozycji w internecie.

Korzyści z integracji pliku Robots.txt z analizą danych z Google Analytics

Integracja pliku Robots.txt z analizą danych z Google Analytics jest kluczowa dla optymalizacji pozycjonowania strony internetowej w wyszukiwarce Google. Dzięki połączeniu tych dwóch komponentów, właściciele stron mogą osiągnąć znaczne usprawnienia w zakresie widoczności i trafności indeksowania swojej witryny w wynikach wyszukiwania.

Zagłębienie w analizę ruchu

Analizując dane z Google Analytics, możesz zidentyfikować, które sekcje witryny są najczęściej odwiedzane i wartościowe dla użytkowników. To informacje mające bezpośredni wpływ na tworzenie optymalnej instrukcji dla robotów wyszukiwarek w pliku Robots.txt. Odpowiednio skonfigurowany plik powinien umożliwiać indeksowanie przez Googlebot treści generujących najwięcej ruchu, co wpłynie na lepsze pozycjonowanie w wynikach wyszukiwania.

Optymalizacja zawartości dla wyszukiwarek

Odpowiednio skonfigurowany plik Robots.txt pozwala na wykluczenie z indeksowania tych obszarów strony, które nie przynoszą wartości dodanej lub mogą wpłynąć na pogorszenie optymalizacji. Dzięki dokładnemu monitorowaniu i analizie danych z Google Analytics, możemy zlokalizować i usunąć z indeksu strony błędne, duplikaty lub te o niskiej jakości, co z kolei przyczyni się do poprawy pozycji witryny w Google.

Harmonijna współpraca z Googlebot

Utworzenie synergii między plikiem Robots.txt a Google Analytics umożliwia bardziej skuteczne przekierowanie zasobów Googlebot na indeksowanie pożądanych treści. Dzięki temu procesowi, można skupić wysiłki robota na stronach, które są kluczowe dla osiągnięcia wyższej konwersji i zaangażowania użytkowników. Akcentując w pliku Robots.txt strony wartościowe, oparte na danych uzyskanych z Google Analytics, wzmacniasz swoją strategię SEO i ułatwiasz robotom wyszukiwarek szybsze dotarcie do najważniejszych dla Twojej działalności treści.

Prawidłowe wykorzystanie pliku Robots.txt w połączeniu z danymi z Google Analytics to gwarancja, że Twoja strona będzie lepiej oceniana przez algorytmy Google, co skutecznie przekłada się na jej lepsze pozycjonowanie. Jest to strategia wymagająca ciągłego monitoringu i dostosowywania, ale oferująca realne korzyści w kontekście widoczności strony i osiągania sukcesu w przestrzeni internetowej.

Jak zajmować się plikiem Robots.txt podczas restrukturyzacji strony lub migracji domeny

Zachowanie ciągłości indeksowania w okresie zmian

Podczas restrukturyzacji witryny lub przeprowadzania migracji domeny, kluczowe jest utrzymanie ciągłości indeksowania przez roboty Google. Plik Robots.txt odgrywa tu zasadniczą rolę, gdyż jest to pierwszy dokument analizowany przez wyszukiwarkę przy wizycie na stronie. Zarządzanie dostępem crawlerów, aby nie tracili one śladu za kluczowymi podstronami, wymaga starannego i przemyślanego podejścia. Zabezpiecz to, przechodząc na nową strukturę lub domenę bez negatywnych konsekwencji dla Twojego SEO.

Przechowywanie starych ścieżek URL i ich przekierowania

Zachowaj listę starych URL-i, które mają wartość SEO i zadbaj o ich właściwe przekierowania 301. W pliku Robots.txt starnej struktury dodaj instrukcje disallow tylko dla tych obszarów, które mają stać się niedostępne dla robotów indeksujących. Nie stosuj blokad na ścieżkach, które zostaną zastąpione nowymi URL-ami – pozwól robotom na ich sprawną aktualizację w bazie danych Google.

Monitoring robotów Google po zmianach

Po wdrożeniu nowej struktury lub domeny, monitoruj zachowanie robotów Google za pomocą Google Search Console. Sprawdzaj, czy nie pojawiają się błędy indeksowania związane z dostępem do zablokowanych zasobów. Upewnij się, że nowy plik Robots.txt nie zawiera błędów i pozwala wyszukiwarce na dostęp do wszystkich istotnych sekcji witryny.

Testowanie i aktualizacja pliku Robots.txt

Zanim wprowadzisz nowy plik Robots.txt na żywo, skorzystaj z narzędzia do testowania Robots.txt w Google Search Console. Takie działanie pozwoli Ci upewnić się, że nowe dyrektywy są rozumiane przez roboty Google tak, jak zamierzasz. Regularnie aktualizuj i optymalizuj plik Robots.txt w świetle zebranych danych, aby dostosować go do ewoluującej struktury strony i ulepszania strategii SEO.

Nie zapominaj o móbilnych użytkownikach

W dzisiejszym świecie indeks mobilny ma pierwszeństwo, co oznacza, że Google przy większości zapytań korzysta z wersji strony przystosowanej do urządzeń mobilnych. Upewnij się, że Twoje zarządzanie plikiem Robots.txt wspiera działanie mobilne wyszukiwarki i nie blokuje ważnych zasobów koniecznych dla odpowiedniego renderowania strony na urządzeniach mobilnych.

Pamiętaj, że odpowiednio skonfigurowany plik Robots.txt to ważny element wpływający na efektywność działań SEO po restrukturyzacji strony lub migracji domeny. Z troską o szczegóły i regularnym monitorowaniem efektów, możesz znacząco przyczynić się do lepszego pozycjonowania Twojej strony w Google.

Jak bots.txt wpływa na wykorzystanie budżetu crawlującego przez roboty Google

Wykorzystanie pliku robots.txt jest kluczowym elementem optymalizacji strony pod kątem wyszukiwarek internetowych takich jak Google. Pełni on rolę strażnika, który informuje roboty Google o tym, jakie sekcje witryny powinny być indeksowane, a które powinny pozostać poza ich zasięgiem. Prawidłowa konfiguracja pliku robots.txt może znacząco przyczynić się do lepszego wykorzystania budżetu crawlującego, to jest ilości zasobów, które Google jest gotowe przeznaczyć na przeszukanie Twojej strony.

Optymalizacja budżetu crawlującego przez właściwą konfigurację

Aby optymalizować budżet crawlujący, należy zadbać o to, aby w pliku robots.txt zablokować dostęp do tych obszarów witryny, które nie przynoszą wartości SEO, takich jak duplikaty stron, strony o niskiej zawartości, czy prywatne katalogi. Dzięki temu robot Google skupi swoje zasoby na analizie wartościowszych treści, co może przełożyć się na lepsze pozycjonowanie witryny w wynikach wyszukiwania.

Zarządzanie indeksacją dynamicznych i zasobożernych stron

Strony generowane dynamicznie, jak komentarze, czy strony z parametrami URL, mogą być kosztowne dla budżetu crawlującego. Używając dyrektyw w robots.txt, możesz ogranić indeksowanie tego typu zasobów, dzięki czemu roboty Google poświęcą więcej uwagi na treści, które mają realny wpływ na widoczność Twojej strony w internecie.

Wykorzystanie rozszerzenia Sitemap w pliku robots.txt

Dodanie informacji o lokacji pliku Sitemap w robots.txt jest kolejnym sposobem na efektywne zarządzanie skanowaniem strony przez roboty. Sitemap to mapa witryny w formacie XML, która pomaga robotom wyszukiwarek zrozumieć strukturę strony internetowej. Poprzez wskazanie robotom, gdzie mogą znaleźć Sitemap, ułatwiasz im pracę i zapewniasz szybsze indeksowanie najważniejszych treści.

Zastosowanie przedstawionych strategii pozwoli zoptymalizować wykorzystanie budżetu crawlującego, skutkując lepszym pozycjonowaniem strony i wyższą widocznością w wynikach wyszukiwania Google. Niezależnie od wielkości i rodzaju Twojej witryny, świadome zarządzanie robots.txt jest nieodzownym elementem strategii SEO.

Omówienie narzędzi SEO wspomagających optymalizację pliku Robots.txt

Najlepsze narzędzia do analizy pliku Robots.txt

Dokładna analiza pliku Robots.txt to kluczowy krok, aby upewnić się, że wyszukiwarki takie jak Google mogą sprawnie indeksować ważne treści na Twojej stronie, jednocześnie pomijając te, których indeksowania się nie życzy. Istnieje szereg narzędzi SEO, które umożliwiają przetestowanie i optymalizację tego pliku. Jednym z nich jest Google Robots Testing Tool, narzędzie dostępne w Google Search Console, które pozwala zobaczyć, jak Googlebot interpretuje Twój plik Robots.txt. Innym przydatnym narzędziem jest Screaming Frog, który oferuje możliwość przeglądania pliku i weryfikacji zasad dla określonych ścieżek.

Zastosowanie optymalizatorów robots.txt online

W wielu przypadkach, szczególnie dla osób mniej zaawansowanych technicznie, sprawdzone optymalizatory online mogą okazać się rozwiązaniem. Takie narzędzia jak Robots.txt Generator lub SEOBook Robots.txt Generator pomagają w tworzeniu skutecznych plików Robots.txt, oferując użytkownikom gotowe szablony i instrukcje krok po kroku. Stosując te narzędzia, możesz łatwo zablokować dostęp do wybranych części witryny oraz optymalizować proces indeksowania, co przyczynia się do lepszego pozycjonowania.

Korzystanie z narzędzi audytowych w celu identyfikacji błędów

Regularny audyt SEO, przeprowadzany z użyciem zaawansowanych narzędzi takich jak Ahrefs czy Semrush, pozwala na identyfikację potencjalnych błędów w pliku Robots.txt, które mogą negatywnie wpływać na widoczność strony w wyszukiwarce. Te kompleksowe narzędzia SEO nie tylko wychwytują problemy związane z plikiem Robots.txt, ale także dostarczają zaleceń, w jaki sposób poprawić optymalizację strony dla wyszukiwarek.

Sprawdzenie dostępu i indeksacji poszczególnych adresów URL

Podczas gdy plik Robots.txt ma za zadanie kierować roboty wyszukiwarek, kluczowe jest także sprawdzenie faktycznego dostępu do poszczególnych adresów URL. Narzędzie Google Search Console oferuje opcję 'Sprawdź jak Googlebot widzi Twoją stronę’, dzięki której możesz w prosty sposób weryfikować, jak poszczególne strony są widziane przez roboty Google i czy nie są blokowane przez błędy w pliku Robots.txt.

Zarządzanie dostępem wyszukiwarek do strony przy pomocy pliku Robots.txt jest niezwykle ważne dla optymalizacji SEO i poprawy widoczności w wynikach wyszukiwania. Wykorzystując wyżej wymienione narzędzia, możesz nie tylko skutecznie zarządzać tym procesem, ale także systematycznie monitorować zmiany i dostosowywać ustawienia tak, aby jak najlepiej wspierały pozycjonowanie Twojej witryny. Pamiętaj, że plik Robots.txt powinien być krokiem wspierającym strategię SEO, a nie jedynym działaniem na rzecz lepszego rankingu w Google.

Plik Robots.txt a mobile-first indexing – jak przygotować się na zmiany w Google

W obliczu ewolucji algorytmów Google, należy przyłożyć szczególną uwagę do optymalizacji pliku robots.txt, zwłaszcza w kontekście mobile-first indexing. Ta metoda indeksowania preferuje wersję mobilną Twojej strony jako główne źródło do oceny i rankingu w wynikach wyszukiwania. Aby najefektywniej zarządzać dostępem wyszukiwarek do treści strony, konieczna jest pełna kompatybilność z wymogami nowoczesnego SEO.

Zrozumienie Mobile-First Indexing

Zmiany w algorytmach wyszukiwania Google podkreślają znaczenie przyjazności witryn dla urządzeń mobilnych. Twoje podejście do pliku robots.txt powinno wziąć pod uwagę, jak roboty Google interpretują i indeksują wersje mobilne stron internetowych. Upewnij się, że plik robots.txt nie blokuje dostępu do żadnych zasobów, które są krytyczne dla wyświetlania strony na urządzeniach mobilnych, takich jak pliki JavaScript, CSS czy obrazy. To kluczowy krok do poprawy widoczności strony w mobile-first index Google.

Optymalizacja pliku Robots.txt pod kątem mobile-first

Przygotowując plik robots.txt do nowych wytycznych Google, ważne jest, aby przeprowadzić audyt SEO i zidentyfikować, które ścieżki są blokowane dla Googlebot-Mobile. Sprawdź, czy nie wykluczasz witryny dla urządzeń mobilnych (User-agent: Googlebot-Mobile), a następnie zastosuj dyrektywy Allow lub Disallow adekwatnie do potrzeb twojej witryny. Nie zapominaj, że przestrzeń dla mobilnych robotów indeksujących strony powinna być jak najbardziej przejrzysta i dostępna.

Testowanie i monitorowanie zmian w pliku Robots.txt

Po wprowadzeniu modyfikacji, niezbędne jest zastosowanie Narzędzia do testowania robots.txt od Google, aby upewnić się, że zmiany są właściwie rozpoznane i nie wprowadziły niezamierzonych blokad. Monitoruj również raporty pokrycia Google Search Console, aby dowiedzieć się, jak zmiany wpłynęły na indeksację strony. Odpowiednia analiza tych danych pozwala nie tylko na lepsze zrozumienie funkcjonowania pliku robots.txt, ale i na szybką reakcję w przypadku wykrycia wszelkich problemów.

Wykorzystanie pliku robots.txt w strategii SEO jest niezwykle istotne, ale pamiętaj, że nie może ono odbywać się kosztem dostępności treści dla użytkowników korzystających z urządzeń mobilnych. Właściwa optymalizacja pod kątem nowych standardów Google może znacząco wpłynąć na poprawę pozycji Twojej strony w wynikach wyszukiwania.

Znaczenie Robots.txt dla lokalnego SEO a zoptymalizowanie dostępu dla Googlebot

Kluczowym elementem efektywnej strategii SEO, zwłaszcza dla lokalnego pozycjonowania, jest umiejętne zarządzanie instrukcjami dla robotów wyszukiwarek, które określa plik robots.txt. Poprawnie skonfigurowany wpływa na to, jak Googlebot indeksuje strony, co ma bezpośredni wpływ na ich widoczność w wynikach wyszukiwania. Należy pamiętać, że robots.txt jest jednym z pierwszych plików analizowanych przez boty wyszukiwarek, dlatego jego optymalizacja jest kluczowa dla zwiększenia skuteczności lokalnego SEO.

Jak Poprawnie Skonfigurować Plik Robots.txt

Należy pamiętać, że robots.txt jest jednym z pierwszych plików analizowanych przez boty wyszukiwarek, dlatego jego optymalna konfiguracja jest kluczowa dla zwiększenia skuteczności lokalnego SEO. Umożliwia on określenie, które części strony mogą być przeszukiwane, a które powinny pozostać niewidoczne dla robotów. Jako właściciel strony, możesz zatem wykorzystać robots.txt do blokowania dostępu do nieistotnych lub prywatnych sekcji strony, które nie powinny być indeksowane, co pozwala Googlebot na skupienie się na najważniejszych dla lokalnego SEO treściach.

Dostosowanie Instrukcji dla Lokalnego Znaczenia

Konfigurując robots.txt pod kątem lokalnego SEO, zastanów się, które katalogi i pliki mają rzeczywiste znaczenie dla użytkowników szukających lokalnych usług lub produktów. Zapewnij indeksowanie stron z mapą witryny, kontaktami i lokalnymi recenzjami. Upewnij się, że wpisy z lokalnymi słowami kluczowymi są dostępne dla Googlebot, co pomoże w precyzyjnym pozycjonowaniu Twojej strony w lokalnych wynikach wyszukiwania.

Unikanie Powszechnych Błędów Konfiguracyjnych

Jedną z najczęstszych pomyłek jest zablokowanie ważnych zasobów, takich jak arkusze stylów CSS lub pliki JavaScript, które są kluczowe dla prawidłowego wyświetlania strony w wynikach wyszukiwania. Przyjazne dla Googlebot formatowanie i ładowanie strony może znacznie wpłynąć na użytkowników lokalnych i ich decyzje. Optymalizując robots.txt, upewnij się, że nie ograniczasz dostępu do tych elementów, które pomagają poprawić odbiór Twojej strony w oczach lokalnej społeczności Google.

Stosując te praktyki optymalizacji pliku robots.txt, zwiększasz szansę na bardziej skuteczne obejmowanie lokalnego rynku przez Twoją stronę i wzmocnienie jej pozycji w wynikach wyszukiwania Google.

Plik Robots.txt a przyszłość pozycjonowania stron – co nas czeka?

Adaptacja Robots.txt w obliczu zmieniających się algorytmów Google

W dobie ciągłej ewolucji algorytmów wyszukiwarek, doskonałe zrozumienie i stosowanie pliku robots.txt staje się kluczowym elementem strategii SEO. Właściwe użycie tego pliku może determinować, jak efektywnie wyszukiwarki indeksują zawartość strony, co bezpośrednio przekłada się na jej widoczność w wynikach wyszukiwania. Precyzyjne wydzielanie sekcji witryny, które mają być dostępne dla robotów Google, pozwala na lepszą alokację zasobów crawlingowych i unikanie indeksowania duplikatów lub nieistotnych podstron.

Robots.txt a Mobile-First Indexing

W kontekście coraz większego znaczenia indeksowania mobile-first, gdzie Google preferuje mobilne wersje stron, odpowiednie skonfigurowanie pliku robots.txt pod kątem wersji mobilnej staje się coraz ważniejsze. Zastosowanie dyrektyw User-agent: Googlebot-Mobile i zapewnienie, że roboty mają dostęp do ważnych zasobów mobilnych, takich jak pliki CSS i JavaScript, może znacznie podnieść ranking strony w mobile SERPs.

Optimization for Voice Search i Featured Snippets

Z uwzględnieniem dynamicznego wzrostu popularności wyszukiwania głosowego oraz featured snippets, robots.txt może odegrać rolę w promowaniu treści, które mają szansę na wyeksponowanie w tych obszarach. Dbając o to, by wyszukiwarki miały dostęp do dobrze strukturyzowanych danych i treści odpowiadających konkretnym zapytaniom, zwiększamy prawdopodobieństwo zaistnienia w kluczowych miejscach na SERP.

Uwzględnienie AI i Machine Learning w strategii robots.txt

Nienaganna współpraca z algorytmami AI, które coraz śmielej wkraczają w świat SEO, staje się niezwłoczna. Elastyczne zarządzanie plikiem robots.txt, dostosowane do zmieniających się priorytetów algorytmów sztucznej inteligencji Google, może przyczynić się do lepszego pozycjonowania. Semantyczne i kontekstowe zrozumienie treści przez AI to wyzwanie, które możemy wspomóc, starannie dopasowując wytyczne w pliku robots.txt.

Praktyczne wskazówki dotyczące pliku robots.txt

Regularne audyty i aktualizacje pliku robots.txt są nieodzowne w procesie pozycjonowania. Zaleca się, aby nie blokować dostępu do żadnych kluczowych zasobów, które wpływają na renderowanie strony. Ponadto, zwróć uwagę na potencjalne błędy w składni, które mogłyby nieprawidłowo wykluczać ważne treści z indeksowania. Korzystanie z narzędzi, takich jak Google Search Console, pozwala na sprawdzanie skuteczności i wykrywanie problemów związanych z plikiem robots.txt.

Pamiętaj, że dobra praktyka SEO wymaga ciągłej obserwacji zmian w algorytmach i odpowiedniego reagowania na nie w pliku robots.txt. Utrzymywanie go w czystości i optymalizacja pod aktualne trendu w pozycjonowaniu zapewniają stronie trwałą i efektywną obecność w wynikach wyszukiwania.

FAQ

Jak stworzyć plik robots.txt dla mojej strony internetowej?

W katalogu głównym swojej strony utwórz plik tekstowy i nazwij go „robots.txt”. Wewnątrz tego pliku umieść dyrektywy, które określają, jak roboty wyszukiwarek powinny indeksować strony na Twojej witrynie. Na przykład, „User-agent: *” dotyczy wszystkich robotów, a „Disallow: /” zabrania indeksowania całej strony.

Czy każda wyszukiwarka przestrzega zasad zapisanych w pliku robots.txt?

Większość szanujących się wyszukiwarek przestrzega zasad zawartych w pliku robots.txt, jednak nie jest to wymóg i istnieją roboty, które mogą te zasady ignorować. Ważne jest, aby zdać sobie sprawę, że plik robots.txt nie jest mechanizmem bezpieczeństwa.

Jak zablokować indeksowanie konkretnego katalogu w pliku robots.txt?

Aby zablokować indeksowanie przez roboty wyszukiwarek konkretnego katalogu, należy użyć dyrektywy „Disallow” w pliku robots.txt. Przykład: „Disallow: /private/” zabroni robotom indeksowania katalogu o nazwie „private”.

Czy mogę zezwolić tylko niektórym robotom na indeksowanie mojej strony?

Tak, możesz zezwolić tylko wybranym robotom na indeksowanie Twojej strony, używając dyrektywy „User-agent”. Następnie określasz, których robotów zasada dotyczy, a dla innych możesz ustawić odpowiednie „Disallow”. Na przykład, „User-agent: Googlebot” pozwoli tylko robotowi Google na indeksowanie.

Jak mogę sprawdzić, czy moja strona poprawnie wykorzystuje plik robots.txt?

Możesz skorzystać z Narzędzia do testowania pliku robots.txt dostępnego w Google Search Console. Umożliwia ono sprawdzenie, czy Twoje zasady w pliku robots.txt są poprawnie zrozumiane przez roboty Google’a i czy nie blokują ważnych zasobów Twojej strony.

Jakie są najczęściej popełniane błędy w plikach robots.txt?

Najczęstsze błędy to: blokowanie ważnego zawartości, które powinno być indeksowane; błędne użycie znaku „/” co może prowadzić do zablokowania większej części strony niż planowano; nieaktualne lub niepoprawne dyrektywy, które nie odzwierciedlają aktualnej struktury strony.

Czy mogę zarządzać dostępem robotów do mojej strony bez użycia pliku robots.txt?

Chociaż plik robots.txt jest najprostszym narzędziem do zarządzania indeksowaniem, istnieją inne metody takie jak meta tagi „noindex” w nagłówkach strony, które mogą zapobiegać indeksowaniu. Ponadto, można stosować atrybut „nofollow” w linkach, aby zapobiec śledzeniu przez roboty.

Czy zmiany w pliku robots.txt są uwzględniane natychmiast przez wyszukiwarki?

Nie, zmiany w pliku robots.txt nie są uwzględniane natychmiast. Roboty wyszukiwarek muszą odwiedzić witrynę i ponownie odczytać plik robots.txt, aby zaaktualizować swoją politykę indeksowania. Może to trwać od kilku dni do tygodni.

Jakie znaczenie ma „Crawl-delay” w pliku robots.txt i czy powinienem go użyć?

Dyrektywa „Crawl-delay” w pliku robots.txt pozwala określić minimalną ilość czasu (w sekundach), jaka powinna upłynąć pomiędzy żądaniami robota do serwera. Niektóre wyszukiwarki respektują tę dyrektywę. Należy jej używać ostrożnie, gdyż może ona spowolnić indeksowanie Twojej strony.

Co zrobić, jeśli chcę zapobiec indeksowaniu mojej strony tymczasowo?

Jeśli chcesz tymczasowo zapobiec indeksowaniu strony, możesz dodać dyrektywę „Disallow: /” w pliku robots.txt. Pamiętaj jednak, aby usunąć tę zasadę, kiedy będziesz chciał ponownie zezwolić na indeksowanie, ponieważ długotrwałe blokowanie może negatywnie wpłynąć na widoczność w wyszukiwarkach.

O autorze | Specjalista SEO: Mateusz Kozłowski

Z pasją zanurzony w świat marketingu internetowego, Mateusz Kozłowski jest ekspertem SEO, rozpoczynającym swoją przygodę z SEO już w 2005 r., gdy mało kto kojarzył pojęcie „pozycjonowania” w Polsce.

Studiował na Wyższej Szkole Informatyki i Zarządzania w Warszawie.

Jeszcze na studiach Mateusz rozpoczął swoją karierę jako specjalista SEO w renomowanej agencji marketingowej w Warszawie. Przez lata pracy zdobył cenne doświadczenie, pracując z różnorodnymi klientami – od małych startupów po duże międzynarodowe korporacje. Jego umiejętności obejmują zarówno SEO techniczne, jak i kreatywne aspekty optymalizacji stron.

W 2011 roku Mateusz postanowił rozpocząć własną działalność w zakresie SEO. Dzięki głębokiej wiedzy teoretycznej oraz praktycznemu doświadczeniu, pomógł wielu firmom zwiększyć ich widoczność w internecie i osiągnąć wyższe pozycje w wynikach wyszukiwania.

Mateusz jest także aktywnym uczestnikiem konferencji branżowych.

Na swoim blogu, Mateusz dzieli się swoją wiedzą i doświadczeniem, oferując czytelnikom praktyczne porady, analizy trendów w SEO oraz strategie, które pomogą im osiągnąć sukces w dynamicznie zmieniającym się świecie pozycjonowania stron internetowych.